Introducción a la programación paralela

Volver a Cursos

Introducción a la Programación Paralela - Código 28661

Carlos Jaime Barrios Hernandez, PhD. - (c b a r r i o s (@) u i s . e d u . c o )

Asistencia Técnica-Teóric:. Equipo SC3UIS y CAGE

PRESENTACION DEL CURSO

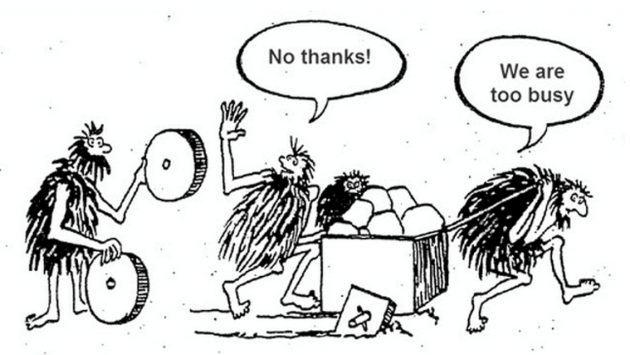

La ruptura tecnológica hace que la computación sea quizás el área del conocimiento más dinámico que existe y que no solo promueve tendencias sino también cambios sociales, desde que la información y su tratamiento no solo es una necesidad sino una exigencia. La computación paralela, si bien no es nada nuevo, como parte de esa "exigencia" permite la explotación de sistemas que desde hace más de treinta años están disponibles, pero que en algunos medios se ve aún como algo exótico, ignorando que gracias a esas posibilidades, desde poder escuchar música, hablar y tomar fotos de manera simultánea en un dispositivo móvil, pasando por pronosticar el clima o mercados, almacenar datos en la nube hasta la realidad de implementar soluciones y algoritmos de inteligencia artificial hoy, existe porque hay múltiples unidades de procesamiento que pueden ser programadas de manera paralela y concurrente.

El curso, que es introductorio, esta dirigido a estudiantes de ingeniería de sistemas y ciencias de la computación, cuyo principal objetivo es ofrecer fundamentos para la explotación de la concurrencia, la explotación de paradigmas de programación dirigidos al paralelismo, sin ignorar algunos conceptos arquitecturales necesarios para entender que soporta ese procesamiento en paralelo. A partir de este curso, los participantes manejaran la terminología necesaria igualmente y tendrán la base para a partir de allí seguir cursos avanzados y seminarios especializados.

Contenido

- Introducción a la Computación Paralela

- Pensamiento Paralelo y Pervasibidad

- Elementos de Paralelismo

- Evolución de la Computación Paralela

- Arquitecturas Paralelas y Sistemas Escalables

- Modelos de Máquinas Paralelas

- Modelos de Ejecución Paralela

- Paralelismo y Comunicación

- Caracterización de Flynn

- Multinucleos y Multiprocesamiento

- Arquitecturas para el Procesamiento Masivamente Paralelo (Manycores)

- Modelos de Memoria

- Jerarquia de Memoria

- Sistemas Distribuidos de Gran Escala

- Algoritmos Concurrentes y Paralelos

- Caracterización de Paralelismo

- Granularidad

- Multihilos y Multiprocesos

- Modelos de Computación (RAM, PRAM, Sorting Networks, BSP, LogP y otros)

- Modelos de Algoritmos Concurrentes

- Descomposición de Tareas

- Descomposición de Datos

- Dividir y Conquistar

- Tuberias (Pipeline)

- Recursividad y Otros (Embarrassingly Parallelism y Otros)

- Algoritmos No Paralelos

- Balanceo de Carga y Calendarización (Scheduling)

- Paradigmas y Modelos de Programación Paralela

- Ambientes de Programación Paralela

- Modelo de Programación de Memoria Compartida

- OpenMP

- Modelo de Programación de Memoria Distribuída

- Paso de Mensajes con MPI

- Modelo Programación de Memoria Híbrida/Heterogénea

- Programación de Sistemas CPU-GPU (Sistemas GPGPU)

- Fundamentos de Programación de GPUs y Múltiples GPU con CUDA

- Programación de Sistemas CPU-GPU (Sistemas GPGPU)

- Uso de Directivas de Aceleración con OpenACC

- Optimización

- Optimización Local y Global Paralela

- Evaluación de Desempeño

- Latencia y Throughput

- Speedup (Aceleración), Eficiencia y Escalabilidad

- Ley de Amhdal

- Ley de Gustaffon-Barsis

- Complejidad Asimptótica (Aceleración y Eficiencia)

- Modelo de Little

- Análisis de Rendimiento y Tunning (Ajuste)

- Debugging and Profiling

- Consideraciones de Debugging y Monitoreo de Rendimiento y Comportamiento

- Herramientas para el Debugging y el Profling

- Lineamientos para el Desarrollo de Aplicaciones Paralelas

- Patrones para el Flujo de Control y de Ejecución

- Patrones para la Administración de Datos

- Espacios de Diseño y Desarrollo de Programas Paralelos

- Búsqueda de Explotación de Concurrencia

- Diseño de Estructura de Algoritmo

- Selección de Estructuras de Soporte de Algoritmos Paralelos

- Selección de Mecanismos de Implementación

- Direcciones y Tendencias en Programación Paralela

- Eficiencia Computacional Hoy (Consumo Energético/Procesamiento)

- Explotación de Unidades Tensor y Aplicaciones Emergentes

- Extracción de Paralelismo en Códigos Secuenciales

- Explotación de Memoria

- Paradigmas de Programación Emergentes

Evaluación

Evaluación 2do Semestre de 2018

BIBLIOGRAFÍA Y FUENTES DE INFORMACION

- The Fourth Paradigm: Data-Intensive Scientific Discovery

- Designing and Building Parallel Programs, by Ian Foster

- Patterns for Parallel Programming, by Timothy G. Mattson, Beverly A. Sanders and Berna L. Massingill. Software Patterns Series, Addison Wesley Ed., USA. 2009

- The Art of Concurrency “A thread Monkey’s Guide to Writing Parallel Applications”, by Clay Breshears (Ed. O Reilly, 2009)

- Parallel Scientific Computing in C++ and MPI « A Seamless Approach to Parallel Algorithms and Their Implementation », Karniadakis and Kirby II (Cambridge Press)

- Algorithms Sequential and Parallel « A Unified Approach » Miller and Boxer (Computing Engineering Series)

- Parallel Algorithms, Cassanova, Legrand and Robert (Chapman and Hall/CRC)

- Programming Massively Parallel Processors « A Hands-on Approach » , Kirk and Hwu (Nvidia/Morgan Kaufmann)

- Introduction to High Performance Computing for Scientists and Engineers, Hager and Wellein (Chapman and Hall/CRC)

- Sourcebook of Parallel Computing , Dongarra, Foster, Fox, Groop, Kennedy, Torczon and White (Morgan Kaufmann)

- CUDA by Example « An Introduction to General-Purpose GPU Programming » Sanders and Kandrot (Nvidia/Addison Wesley)

- NVIDIA

- SC3

- Computing.llnl.gov

- SC-Camp